Si no puedes señalarlo, no puedes fiarte

De piloto a producción · 03

Solo el 36% de las empresas afirma que sus sistemas de Document AI pueden trazar los valores extraídos hasta el documento fuente. El resto opera a ciegas: extracción sin evidencia, automatización sin auditabilidad. En un panorama regulatorio marcado por la EU AI Act, el GDPR y DORA, esa brecha se está volviendo insostenible.

Un cliente potencial me enseñó algo el año pasado en lo que no dejo de pensar.

Llevaban seis meses usando una herramienta de Document AI. Funcionaba, más o menos. Las tasas de extracción eran aceptables, el equipo se había adaptado al flujo de validación y las facturas entraban en su ERP más rápido que antes.

Entonces llegó una auditoría interna.

Los auditores seleccionaron una muestra de facturas procesadas. Procedimiento estándar. Querían verificar un conjunto de totales extraídos contra los documentos fuente. El sistema tenía los números. Los datos estructurados estaban limpios. Pero cuando los auditores hicieron la pregunta obvia — "¿de dónde del documento salió este valor?" — nadie supo responder.

El sistema no podía mostrar su trabajo.

No es que "no quisiera". No podía. La herramienta de extracción producía resultados — número de factura, fecha, total, líneas de detalle — pero no había vínculo con el origen. No había forma de señalar una región del PDF y decir "el sistema leyó este número de esta celda, en esta tabla, en esta página". La conexión entre entrada y salida era invisible.

No suspendieron la auditoría porque los números estuviesen mal. Suspendieron porque no podían demostrar que estaban bien.

El problema de la caja negra en el corazón del Document AI

Esto no es inusual. Es lo habitual.

La mayoría de herramientas de extracción documental funcionan así: entra un documento, sale información estructurada, y la relación entre ambos es opaca. El sistema puede usar OCR, visión por computador, modelos de lenguaje, motores de reglas o alguna combinación de todo ello, pero el resultado es un conjunto plano de pares clave-valor sin trazabilidad.

Para una demo, es suficiente. Muestras el documento de entrada, muestras el JSON extraído, el comprador los compara visualmente, todos coinciden en que parece correcto.

Para producción, es un problema. Y el problema crece cuanto más escalas.

Con 100 documentos al día, una persona puede hacer comprobaciones puntuales abriendo el PDF original y buscando visualmente los valores extraídos. Es tedioso, pero posible.

Con 10.000 documentos al día, nadie comprueba nada. La salida fluye directamente a tu ERP, tu sistema de pagos, tus informes de cumplimiento. Si un valor está mal, te enteras cuando el pago es rechazado, la declaración fiscal falla o el auditor hace una pregunta que no puedes responder.

Este es el problema de la caja negra. No en el sentido teórico de la ética de la IA. En el sentido muy práctico de: tu sistema toma miles de decisiones diarias sobre datos financieros, y no puedes inspeccionar ninguna de ellas.

Todo marco de gobernanza existente exige trazabilidad. Extracción sin grounding es gobernanza sin evidencia.

Qué significa realmente el visual grounding en el procesamiento de documentos

El visual grounding es la capacidad de vincular cada valor extraído con la región exacta del bounding box en el documento fuente donde el sistema lo encontró, creando una cadena de procedencia trazable y auditable desde la entrada hasta la salida.

No a nivel de página. No a nivel de párrafo. El bounding box específico — las coordenadas precisas — del texto, celda o región que produjo el resultado.

Cuando el sistema extrae un total de factura de 14.320 €, también almacena: "He leído este valor de la celda en las coordenadas [x1, y1, x2, y2] en la página 2 del documento fuente". Cuando un revisor humano, un auditor o una regla de validación automática necesita verificar ese valor, puede ir directamente a la ubicación en el documento. Sin buscar. Sin adivinar. Sin abrir el PDF y recorrer la página con la esperanza de encontrar de dónde salió el número.

Suena sencillo. Arquitectónicamente, no lo es en absoluto. Requiere que el sistema de extracción mantenga un mapeo persistente entre su comprensión de la estructura del documento y cada resultado que produce. La mayoría de los pipelines de extracción están diseñados como flujos unidireccionales: documento dentro, datos fuera. Construir grounding implica mantener viva toda la relación espacial a lo largo del pipeline, lo que añade complejidad a cada capa del sistema.

En anyformat tomamos esta decisión arquitectónica fundacional desde el primer día. No como una funcionalidad añadida después. Como una restricción de diseño que condicionó cómo construimos todo lo demás.

He aquí por qué.

Tres cosas que el grounding hace posibles y nada más puede

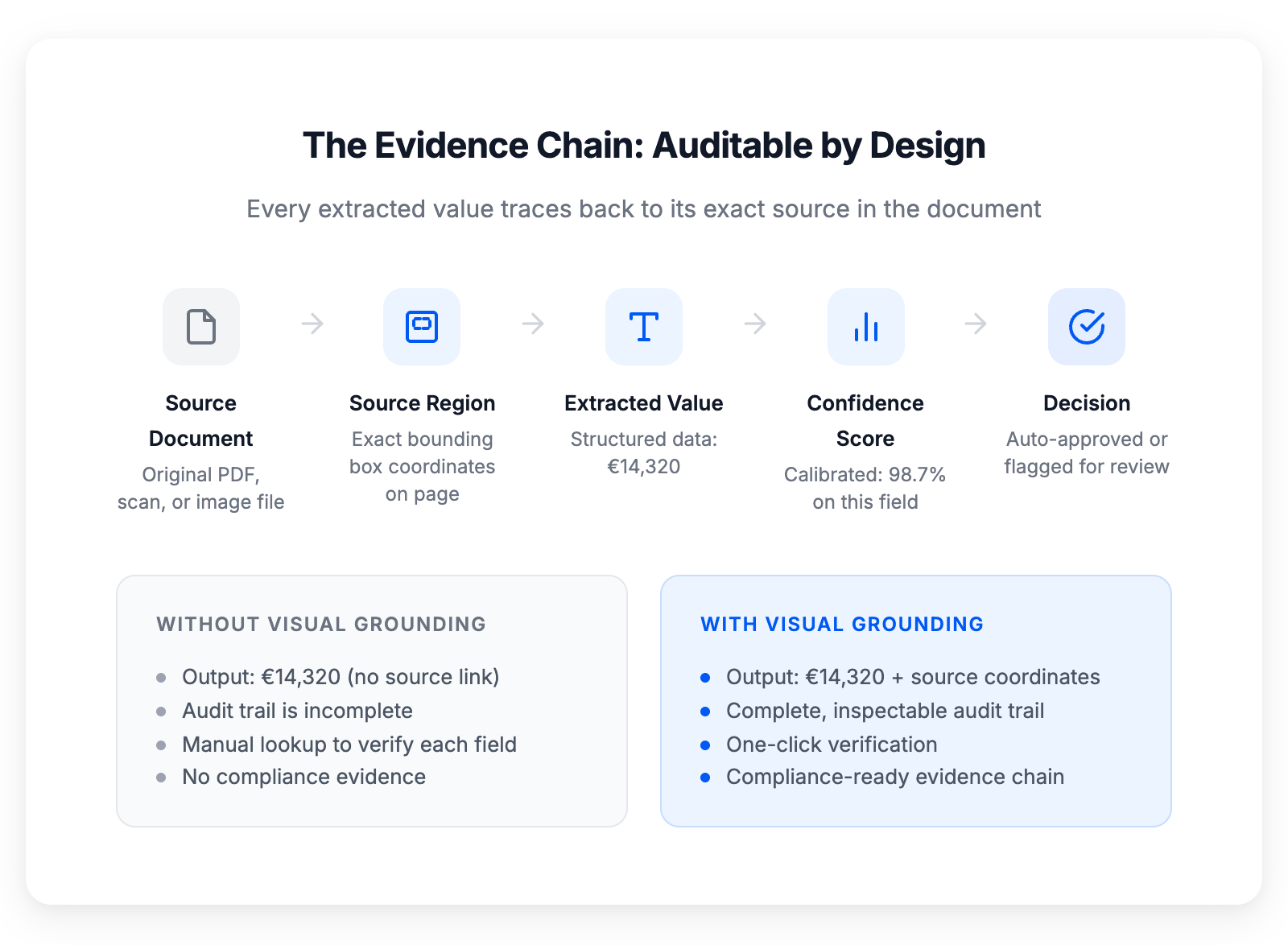

El visual grounding crea una cadena de evidencia completa y auditable para cada valor extraído

El visual grounding crea una cadena de evidencia completa y auditable para cada valor extraído

01 · Automatización auditable para el cumplimiento regulatorio

Esta es la más evidente, y es la que hundió la auditoría de mi cliente potencial. Cuando cada resultado está vinculado a su fuente, tienes una cadena completa de evidencia: este documento → esta región → este valor → esta puntuación de confianza → esta decisión (aprobada automáticamente o revisada por un humano). Un auditor puede seguir esa cadena en segundos. Sin ella, tiene que reconstruir la lógica desde cero, que es lo que "suspender una auditoría" realmente significa en la práctica.

La presión regulatoria aquí no hace más que aumentar. La EU AI Act exige que los sistemas de IA de alto riesgo (lo que incluye sistemas que toman decisiones automatizadas sobre datos financieros) sean transparentes y explicables. Las disposiciones del GDPR sobre decisiones automatizadas aplican cuando el procesamiento automático afecta a personas. Los próximos mandatos de facturación electrónica ViDA exigirán un linaje de datos trazable para transacciones transfronterizas, con despliegue completo en julio de 2030. Y DORA — el Reglamento de Resiliencia Operativa Digital, aplicable desde enero de 2025 — añade requisitos adicionales de trazabilidad para empresas de servicios financieros en toda la UE.

El visual grounding no se adelanta a la regulación. La regulación está alcanzando lo que los sistemas en producción deberían haber tenido desde siempre.

02 · Revisión humana más rápida y focalizada

En el artículo anterior, hablé sobre las puntuaciones de confianza a nivel de campo — cómo un sistema que sabe cuándo tiene incertidumbre permite a tu equipo revisar solo los campos que necesitan atención en lugar de todo.

El visual grounding hace que esa revisión sea drásticamente más rápida.

Cuando un campo se marca para revisión humana, el revisor no solo ve el valor extraído y la puntuación de confianza. Ve la ubicación exacta en el documento fuente donde el sistema lo leyó. No necesita abrir el PDF y buscar. No necesita recordar cómo es un número de pedido en el formato de factura de este proveedor. El sistema señala directamente la región fuente.

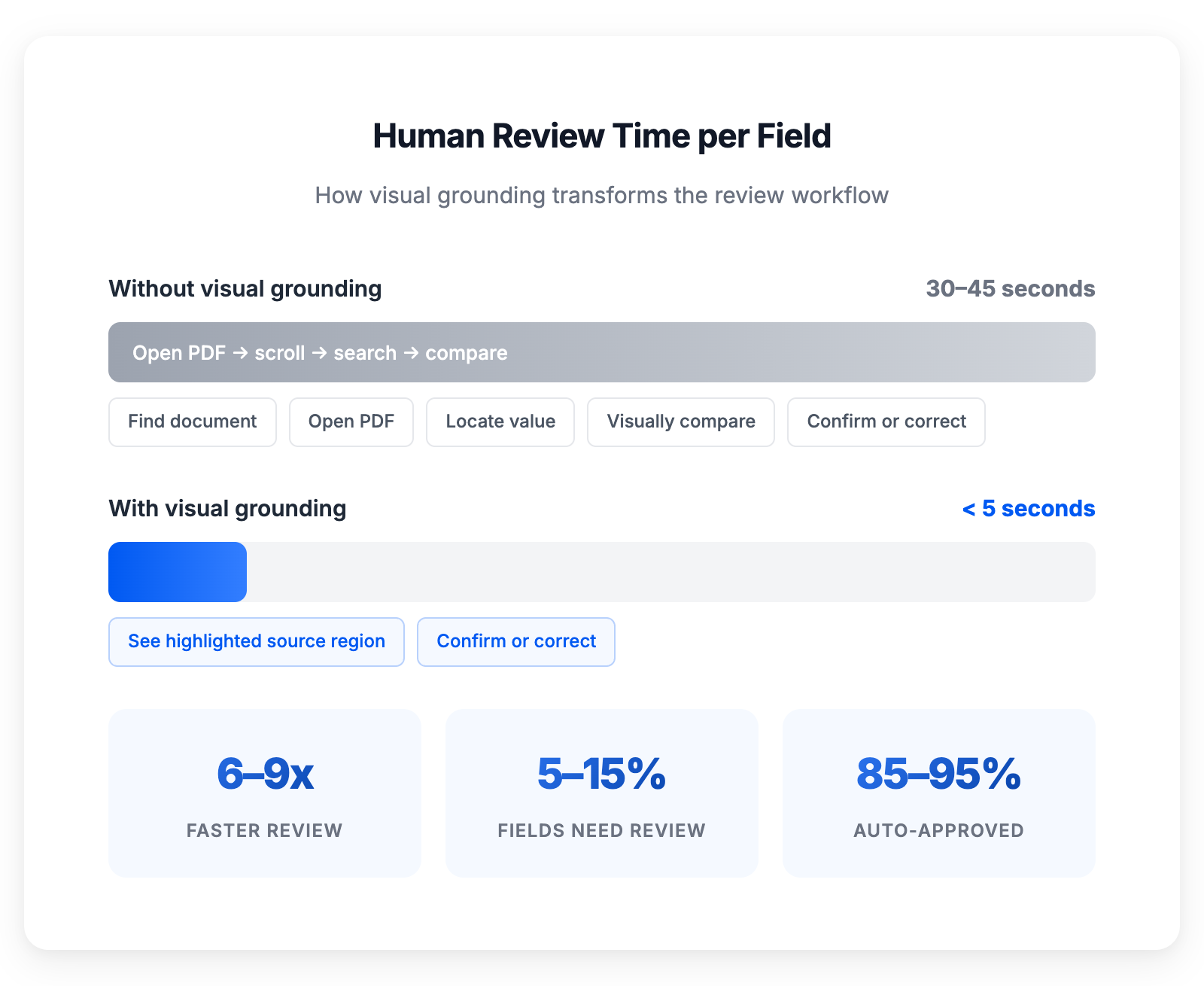

La diferencia es medible.

El visual grounding elimina el paso de búsqueda, transformando la revisión de una búsqueda manual a una confirmación de un vistazo

El visual grounding elimina el paso de búsqueda, transformando la revisión de una búsqueda manual a una confirmación de un vistazo

Hemos visto cómo los tiempos de revisión bajan de 30–45 segundos por campo (encontrar el documento, abrirlo, localizar el valor, comparar) a menos de 5 segundos (ver el valor extraído, ver la región fuente, confirmar o corregir). A escala — miles de campos al día que requieren revisión — es la diferencia entre un equipo de revisión a jornada completa y una tarea a tiempo parcial. McKinsey cifra la oportunidad en un 40% menos de costes de procesamiento cuando los flujos documentales están correctamente automatizados, y la revisión humana focalizada mediante grounding es lo que hace posible esa "correcta automatización".

03 · Mejora continua a través de patrones de error visibles

Cuando el sistema comete un error y un humano lo corrige, el visual grounding te dice no solo qué falló, sino dónde y por qué.

El sistema leyó mal un valor. ¿Dónde estaba mirando? ¿Estaba leyendo de la celda equivocada? ¿Confundió un subtotal con un total? ¿El texto en esa región estaba degradado por un escaneo deficiente? ¿El diseño cambió respecto a facturas anteriores del mismo proveedor?

Sin grounding, la corrección de errores es a ciegas — sabes que el resultado era incorrecto, pero no puedes ver qué vio el sistema cuando cometió el error. Con grounding, puedes identificar patrones: las facturas de este proveedor generan errores sistemáticamente en el campo del código fiscal porque su diseño lo coloca en una posición inusual. Eso es accionable. Puedes refinar el comportamiento del sistema, o marcar las facturas de ese proveedor para revisión humana automática en ese campo específico.

Los patrones de error se hacen visibles. La mejora se convierte en algo sistemático en vez de aleatorio.

Un sistema que no puede mostrar dónde miró no puede explicar por qué se equivocó. El visual grounding convierte la corrección de errores de adivinanza en ingeniería.

El coste de no tener visual grounding

Quiero ser concreto sobre lo que ocurre cuando falta, porque el coste no siempre es evidente de entrada.

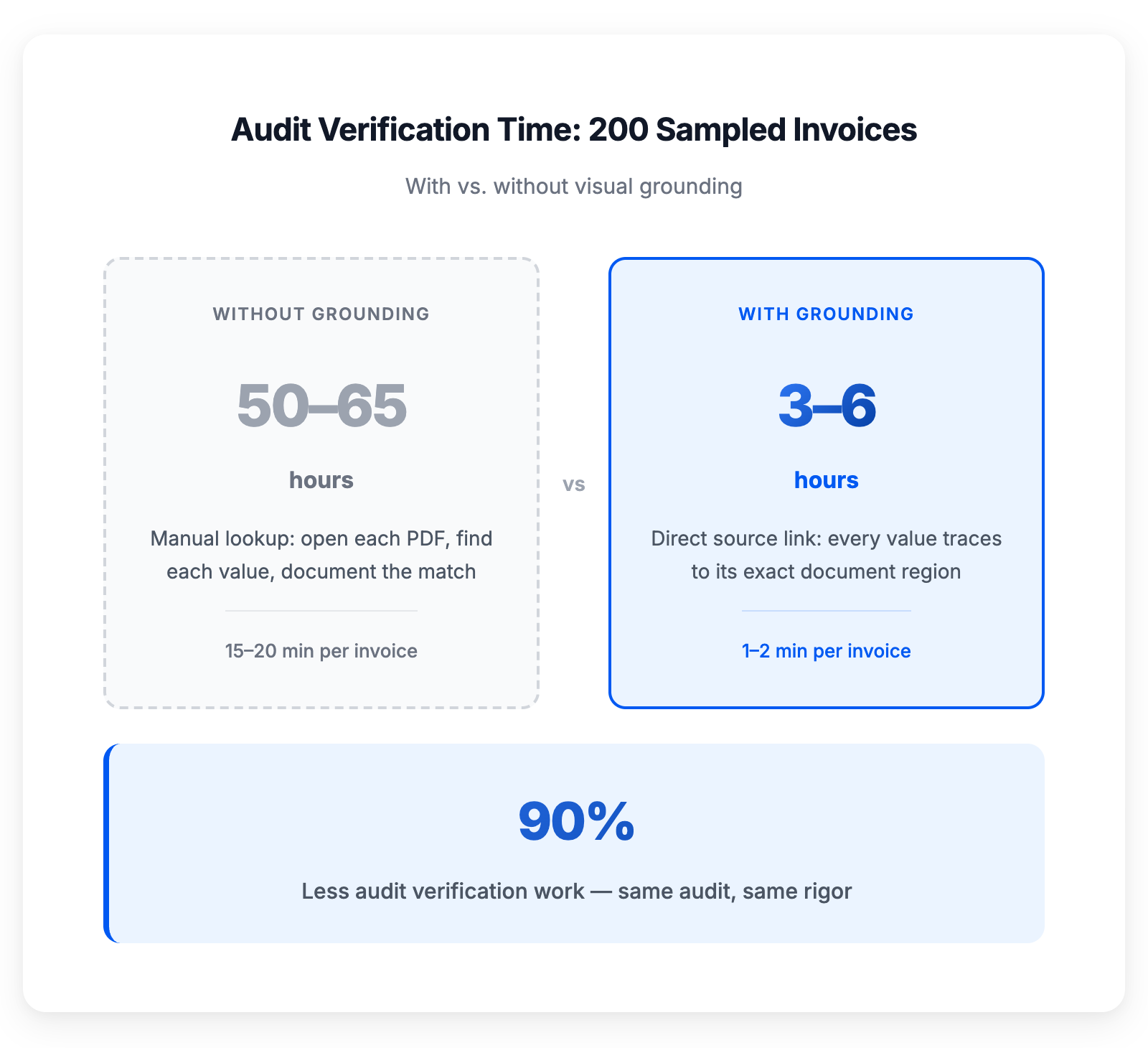

Misma auditoría, mismo rigor — un 90% menos de trabajo de verificación

Misma auditoría, mismo rigor — un 90% menos de trabajo de verificación

El escenario de auditoría

Una empresa regulada procesa 50.000 facturas al año con su herramienta de extracción. Una auditoría externa selecciona 200 para verificación. Sin grounding, alguien del equipo tiene que abrir manualmente cada documento fuente, encontrar cada valor extraído y documentar la correspondencia. A 15–20 minutos por factura para una verificación rigurosa, son 50–65 horas de trabajo. En cada ciclo de auditoría. Con grounding, la misma verificación lleva 1–2 minutos por factura porque el vínculo entre resultado y fuente ya está ahí. Son 3–6 horas. Misma auditoría, un 90% menos de trabajo.

El escenario de erosión de confianza

El sistema de extracción comete un error que llega a un pago. El pago es incorrecto. El equipo financiero investiga. Encuentran el valor extraído. Abren el documento fuente. No pueden determinar de dónde leyó el sistema el número, porque el sistema no almacena esa información. ¿Fue un error del sistema? ¿Un problema de calidad del documento? ¿Una ambigüedad genuina en la fuente? No pueden saberlo. Registran el error, corrigen el pago y siguen adelante. Pero la confianza del equipo en el sistema cae. Empiezan a comprobar más resultados manualmente. En pocos meses, el proceso "automatizado" tiene una capa de revisión manual creciente que no estaba en el plan original y no está en el presupuesto.

El escenario de cumplimiento

El Artículo 14 de la EU AI Act exige supervisión humana para los sistemas de IA de alto riesgo, incluyendo la capacidad de que los humanos comprendan la salida del sistema e intervengan cuando sea necesario. El Artículo 13 exige transparencia — los usuarios deben poder interpretar la salida del sistema de forma adecuada. Sin grounding, interpretar significa abrir el documento fuente y esperar a descifrar lo que hizo el sistema. Con grounding, la interpretación está integrada en la salida. Esto no es riesgo regulatorio teórico. La aplicación de la AI Act comienza por fases a partir de 2025, con plena vigencia en agosto de 2027.

Lo que vemos en la práctica

Voy a compartir algo concreto sobre cómo funciona esto en anyformat.

Cuando nuestro sistema procesa un documento, cada campo extraído lleva tres cosas: el valor, la puntuación de confianza y las coordenadas de grounding. El grounding no es una aproximación — es el bounding box preciso del texto fuente en el documento original.

En nuestra interfaz de revisión, cuando un campo se marca para atención humana, el revisor ve el valor extraído a un lado y el documento fuente al otro, con la región relevante resaltada. No busca. No hace scroll. Mira la región resaltada, la compara con el valor extraído, y confirma o corrige. La interacción completa lleva segundos.

Cuando corrigen un valor, la corrección se almacena junto con la extracción original y los datos de grounding. Esto crea un bucle de retroalimentación: podemos analizar qué regiones del documento, qué diseños, qué tipos de campo producen más correcciones, y mejorar el comportamiento del sistema exactamente en esos casos.

Los datos de grounding también fluyen aguas abajo. Cuando la salida estructurada entra en tu ERP o sistema de pagos, la procedencia viaja con ella. Un auditor que mira una factura procesada en tu sistema puede trazar cualquier valor hasta su región fuente en el documento original, sin tocar directamente la herramienta de extracción.

Esto es lo que significa "auditable por diseño". No una funcionalidad que activas. Una propiedad arquitectónica que existe en cada resultado que produce el sistema.

El principio de fondo: la inspeccionabilidad genera confianza

Hay un patrón en cómo los sistemas de ingeniería se ganan la confianza. No es acertando más a menudo — aunque eso importa. Es siendo inspeccionables.

Los sistemas en los que más confiamos en el mundo físico son los que podemos examinar. Confiamos en los puentes no porque creamos que nunca van a fallar, sino porque podemos inspeccionar cada soldadura, cada viga, cada cimiento. Confiamos en los aviones no porque asumamos perfección, sino porque cada componente tiene un historial de fabricación trazable y cada vuelo produce datos de mantenimiento auditables.

El Document AI debería funcionar igual. No "confía en nosotros, la IA es muy lista". Sino "aquí tienes exactamente lo que leyó el sistema, exactamente dónde lo leyó, cómo de seguro está, y la cadena de evidencia completa".

Confianza, por diseño.

Preguntas frecuentes

¿Qué es el visual grounding en Document AI? El visual grounding significa que cada valor extraído está vinculado a las coordenadas exactas del bounding box en el documento fuente donde el sistema lo encontró. En lugar de producir resultados opacos de clave-valor, un sistema con grounding muestra con precisión qué región de qué página produjo cada valor, haciendo cada extracción inspeccionable y verificable.

¿Por qué es importante el visual grounding para el cumplimiento de auditorías documentales? Marcos regulatorios como la EU AI Act, el GDPR y DORA exigen que los sistemas de IA que procesan datos financieros sean transparentes, explicables y auditables. El visual grounding proporciona la cadena de evidencia que los auditores necesitan: documento fuente → región fuente → valor extraído → puntuación de confianza → decisión. Sin él, las organizaciones se enfrentan a lagunas de cumplimiento y auditorías fallidas.

¿Cómo reduce el visual grounding el tiempo de revisión humana en el procesamiento de documentos? Con visual grounding, los revisores ven el valor extraído junto a la región fuente resaltada en el documento original. Esto elimina la búsqueda manual, reduciendo el tiempo de revisión por campo de 30–45 segundos a menos de 5 segundos. A escala, esto transforma equipos de revisión a jornada completa en roles de supervisión a tiempo parcial.

¿Qué exige la EU AI Act en cuanto a transparencia en el procesamiento de documentos? La EU AI Act clasifica los sistemas de IA que procesan documentos financieros como de alto riesgo. El Artículo 13 exige transparencia suficiente para que los implementadores interpreten los resultados adecuadamente. El Artículo 14 exige capacidades de supervisión humana. La plena aplicación para sistemas de alto riesgo comienza en agosto de 2027.

¿Cuál es la diferencia entre el visual grounding y el OCR estándar? El OCR estándar convierte imágenes de texto en caracteres legibles por máquina, pero normalmente no mantiene un vínculo persistente entre los valores extraídos y sus ubicaciones de origen. El visual grounding va más allá: conserva las coordenadas exactas y el contexto espacial de cada resultado, creando una cadena de procedencia trazable desde el documento fuente hasta los datos estructurados.

¿Cómo apoya el visual grounding el cumplimiento de la EU AI Act en el procesamiento de documentos? La EU AI Act clasifica los sistemas de IA que procesan documentos financieros como de alto riesgo. El Artículo 13 exige transparencia para que los implementadores puedan interpretar los resultados. El Artículo 14 requiere supervisión humana con capacidad para comprender e intervenir. El visual grounding satisface directamente ambos requisitos al vincular cada resultado con su evidencia de origen. La aplicación comienza en agosto de 2027 para los sistemas de alto riesgo.

¿Qué es la IA explicable (XAI) en el procesamiento de documentos? La IA explicable se refiere a sistemas de IA cuyas decisiones pueden ser comprendidas, inspeccionadas y verificadas por humanos. En el procesamiento de documentos, esto significa que el sistema puede mostrar no solo qué extrajo, sino dónde en el documento fuente encontró cada valor y cómo de seguro está. El visual grounding es el mecanismo principal para lograr explicabilidad en el procesamiento inteligente de documentos.

Próximo en la serie: El impuesto del entrenamiento — por qué el mejor Document AI es el que no tienes que enseñar.

Anteriormente: Más allá de la precisión: las métricas de Document AI que realmente predicen el éxito en producción — qué medir cuando tus documentos realmente importan.

Inicio de la serie: La paradoja del papel: por qué el Document AI todavía no ha sustituido el trabajo manual — lo que más de 100 conversaciones con empresas me enseñaron sobre Document AI.

Envíanos tus documentos más difíciles →

Descubre cómo compara anyformat: vs Azure Document Intelligence · vs ABBYY · vs Google Document AI · vs ChatGPT, Claude & Gemini · Todas las comparaciones →

Juan Huguet · CEO & Co-founder, anyformat.ai · Ingeniero Nuclear · Doctor en Física